Come utilizzare una finestra buffer di conversazione in LangChain?

La finestra del buffer di conversazione viene utilizzata per mantenere in memoria i messaggi più recenti della conversazione per ottenere il contesto più recente. Utilizza il valore della K per archiviare messaggi o stringhe in memoria utilizzando il framework LangChain.

Per apprendere il processo di utilizzo della finestra del buffer di conversazione in LangChain, segui semplicemente la seguente guida:

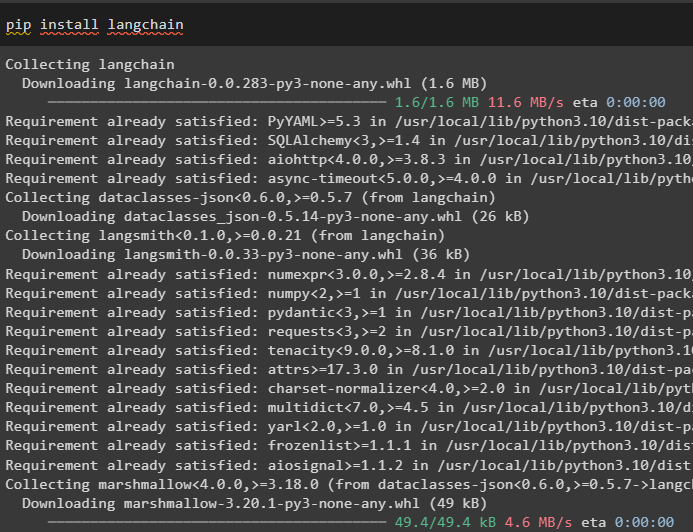

Passaggio 1: installare i moduli

Avvia il processo di utilizzo della finestra del buffer di conversazione installando il modulo LangChain con le dipendenze richieste per creare modelli di conversazione:

pip installa langchain

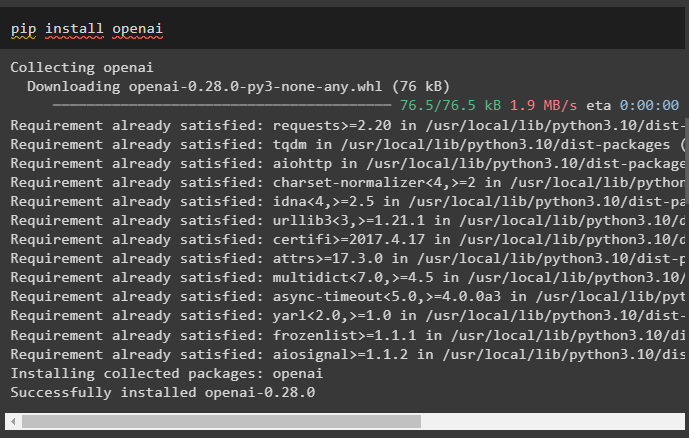

Successivamente, installa il modulo OpenAI che può essere utilizzato per creare modelli linguistici di grandi dimensioni in LangChain:

pip installa openai

Ora, configurare l'ambiente OpenAI per costruire le catene LLM utilizzando la chiave API dell'account OpenAI:

importare Voi

importare getpass

Voi . circa [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Chiave API OpenAI:' )

Passaggio 2: utilizzo della memoria della finestra del buffer di conversazione

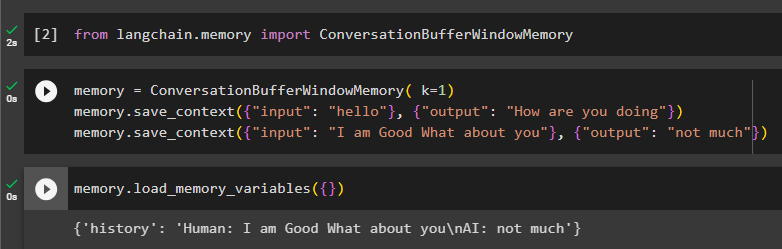

Per utilizzare la memoria della finestra del buffer di conversazione in LangChain, importare il file ConversationBufferWindowMemory biblioteca:

da langchain. memoria importare ConversationBufferWindowMemoryConfigurare la memoria utilizzando il ConversationBufferWindowMemory () metodo con il valore di k come argomento. Il valore di k verrà utilizzato per conservare i messaggi più recenti della conversazione e quindi configurare i dati di addestramento utilizzando le variabili di input e output:

memoria = ConversationBufferWindowMemory ( K = 1 )memoria. salva_contesto ( { 'ingresso' : 'Ciao' } , { 'produzione' : 'Come va' } )

memoria. salva_contesto ( { 'ingresso' : 'Sto bene e tu' } , { 'produzione' : 'non tanto' } )

Metti alla prova la memoria chiamando il carica_variabili_memoria () metodo per avviare la conversazione:

memoria. carica_variabili_memoria ( { } )

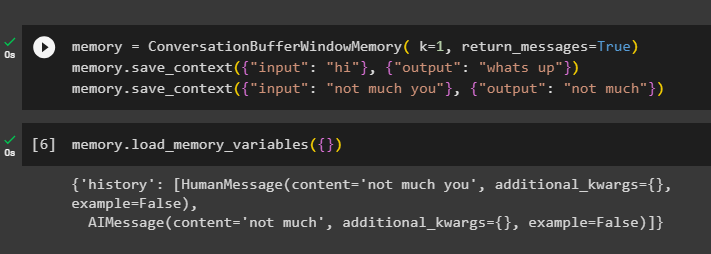

Per ottenere la cronologia della conversazione, configura la funzione ConversationBufferWindowMemory() utilizzando il file return_messages discussione:

memoria = ConversationBufferWindowMemory ( K = 1 , return_messages = VERO )memoria. salva_contesto ( { 'ingresso' : 'CIAO' } , { 'produzione' : 'che cosa succede' } )

memoria. salva_contesto ( { 'ingresso' : 'non molto tu' } , { 'produzione' : 'non tanto' } )

Ora richiama la memoria utilizzando il comando carica_variabili_memoria () metodo per ottenere la risposta con la cronologia della conversazione:

memoria. carica_variabili_memoria ( { } )

Passaggio 3: utilizzo della finestra buffer in una catena

Costruisci la catena usando il OpenAI E Catena di conversazione librerie e quindi configurare la memoria buffer per archiviare i messaggi più recenti nella conversazione:

da langchain. Catene importare Catena di conversazioneda langchain. llms importare OpenAI

#costruzione di un riassunto della conversazione utilizzando più parametri

conversazione_con_riepilogo = Catena di conversazione (

llm = OpenAI ( temperatura = 0 ) ,

#costruire un buffer di memoria utilizzando la sua funzione con il valore k per memorizzare i messaggi recenti

memoria = ConversationBufferWindowMemory ( K = 2 ) ,

#configure variabile dettagliata per ottenere un output più leggibile

prolisso = VERO

)

conversazione_con_riepilogo. prevedere ( ingresso = 'Ciao come va' )

Ora continua la conversazione ponendo la domanda relativa all'output fornito dal modello:

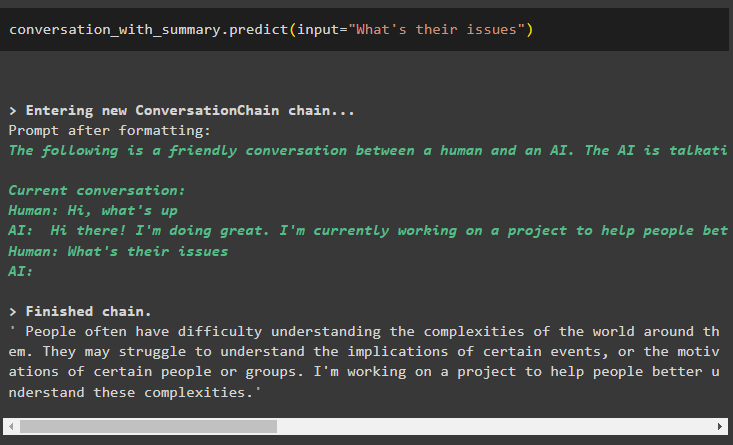

conversazione_con_riepilogo. prevedere ( ingresso = 'Quali sono i loro problemi' )

Il modello è configurato per memorizzare solo un messaggio precedente che può essere utilizzato come contesto:

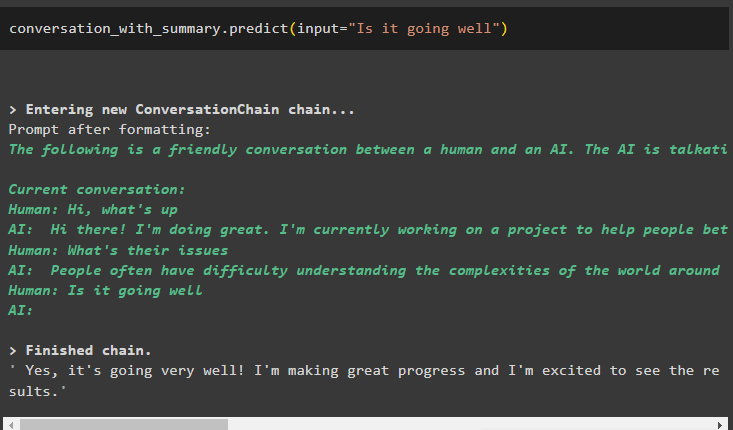

conversazione_con_riepilogo. prevedere ( ingresso = 'Sta andando bene' )

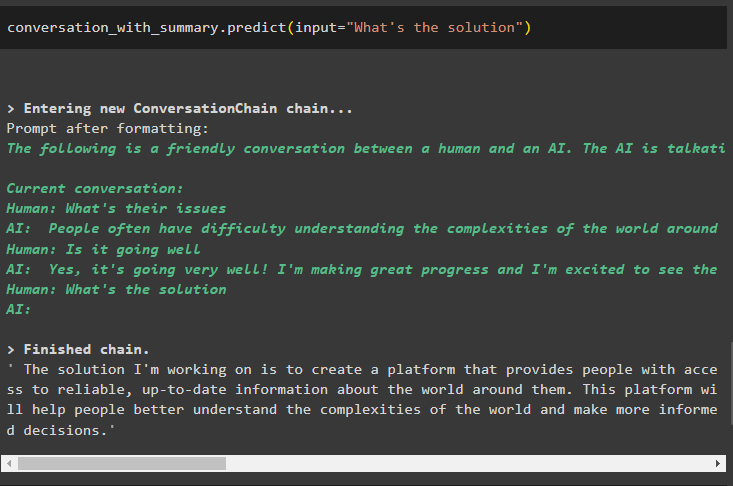

Richiedi la soluzione ai problemi e la struttura di output continuerà a far scorrere la finestra del buffer rimuovendo i messaggi precedenti:

conversazione_con_riepilogo. prevedere ( ingresso = 'Qual è la soluzione' )

Questo è tutto incentrato sul processo di utilizzo delle finestre del buffer di conversazione LangChain.

Conclusione

Per utilizzare la memoria della finestra del buffer di conversazione in LangChain, è sufficiente installare i moduli e configurare l'ambiente utilizzando la chiave API di OpenAI. Successivamente, crea la memoria buffer utilizzando il valore di k per conservare i messaggi più recenti nella conversazione e mantenere il contesto. La memoria buffer può essere utilizzata anche con catene per avviare la conversazione con LLM o catena. Questa guida ha approfondito il processo di utilizzo della finestra del buffer di conversazione in LangChain.