Contorno rapido

Questo post dimostrerà quanto segue:

Cosa sono gli agenti nell'elaborazione del linguaggio naturale (NLP)

Iniziare con gli agenti in LangChain

- Installazione di framework

- Configura il modello di chat

- Agente edile

- Invocare l'agente

- Configura gli strumenti dell'agente

- Testare l'agente

Cosa sono gli agenti nell'elaborazione del linguaggio naturale (NLP)?

Gli agenti sono i componenti vitali dell'applicazione del linguaggio naturale e utilizzano la Natural Language Understanding (NLU) per comprendere le query. Questi agenti sono programmi che agiscono come un modello di conversazione per interagire con gli esseri umani utilizzando la sequenza di attività. Gli agenti utilizzano più strumenti che possono essere richiamati dall'agente per eseguire più azioni o specificare l'attività successiva da eseguire.

Iniziare con gli agenti in LangChain

Avvia il processo di creazione degli agenti per conversare con gli esseri umani estraendo l'output utilizzando gli agenti in LangChain. Per apprendere il processo per iniziare con gli agenti in LangChain, segui semplicemente i passaggi elencati di seguito:

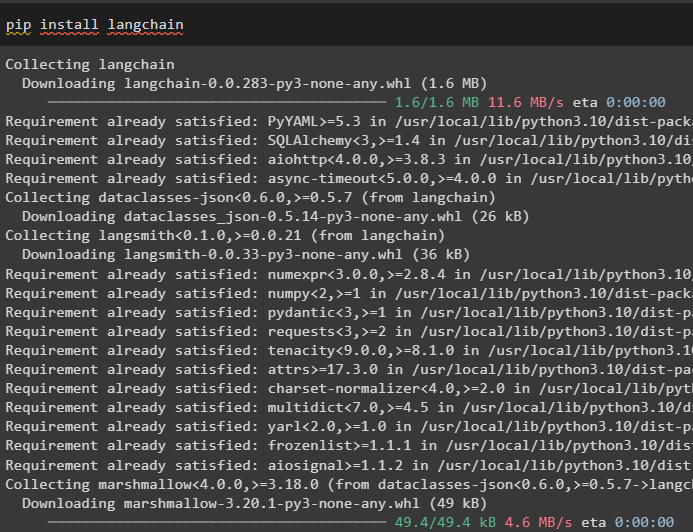

Passaggio 1: installazione dei framework

Innanzitutto, inizia con il processo di installazione del framework LangChain utilizzando il ' pip 'comando per ottenere le dipendenze richieste per l'utilizzo degli agenti:

pip installa langchain

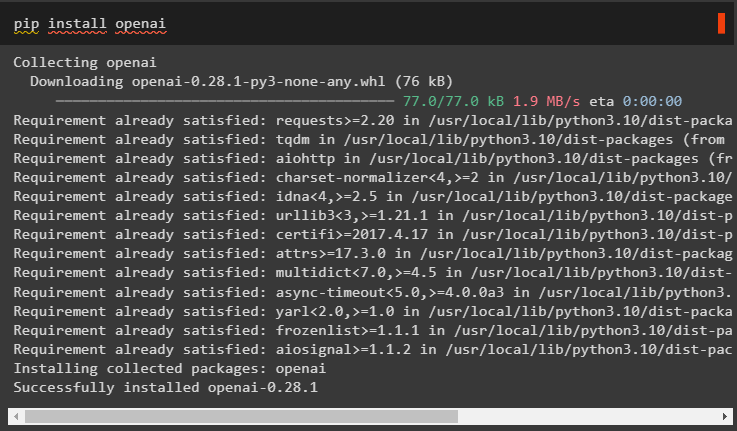

Installa il modulo OpenAI per costruire LLM e usalo per configurare gli agenti in LangChain:

pip installa openai

Configura l'ambiente per il modulo OpenAI utilizzando la relativa chiave API dall'account eseguendo il seguente codice:

importare Voiimportare getpass

Voi . circa [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Chiave API OpenAI:' )

Passaggio 2: configura il modello di chat

Importa il modulo ChatOpenAI da LangChain per costruire LLM utilizzando la sua funzione:

da langchain. chat_models importare ChatOpenAIllm = ChatOpenAI ( temperatura = 0 )

Strumenti di importazione per l'agente per configurare le attività o le azioni che devono essere eseguite dall'agente. Il codice seguente utilizza il metodo get_word_length() per ottenere la lunghezza della parola fornita dall'utente:

da langchain. agenti importare attrezzo@ attrezzo

def ottieni_lunghezza_parola ( parola: stra ) - > int :

'''ottenere la lunghezza della parola'''

ritorno soltanto ( parola )

utensili = [ ottieni_lunghezza_parola ]

Configura il modello o la struttura per il modello di chat per creare un'interfaccia per avere una chat:

da langchain. richiede importare ChatPromptTemplate , MessaggiPlaceholderrichiesta = ChatPromptTemplate. da_messaggi ( [

( 'sistema' , 'il tuo assistente è davvero straordinario, ma necessita di miglioramenti nel calcolo delle lunghezze' ) ,

( 'utente' , '{ingresso}' ) ,

MessaggiPlaceholder ( nome_variabile = 'agente_scratchpad' ) ,

] )

Passaggio 3: Agente edile

Importa la libreria di strumenti per costruire il LLM con strumenti utilizzando le funzioni OpenAI dal modulo LangChain:

da langchain. utensili . rendere importare format_tool_to_openai_functionllm_with_tools = llm. legamento (

funzioni = [ format_tool_to_openai_function ( T ) per T In utensili ]

)

Configura l'agente utilizzando l'agente della funzione OpenAI per utilizzare il parser di output per impostare le sequenze di azioni/attività:

da langchain. agenti . format_scratchpad importare format_to_openai_functionsda langchain. agenti . output_parser importare OpenAIFunctionsAgentOutputParser

agente = {

'ingresso' : lambda x:x [ 'ingresso' ] ,

'agente_scratchpad' : lambda x: format_to_openai_functions ( X [ 'passi_intermedi' ] )

} | richiesta | llm_with_tools | OpenAIFunctionsAgentOutputParser ( )

Passaggio 4: richiamare l'agente

Il passaggio successivo utilizza la funzione invoke() per chiamare l'agente utilizzando gli argomenti input e intermedi_steps:

agente. invocare ( {'ingresso' : 'quante lettere nella parola buono' ,

'passi_intermedi' : [ ]

} )

Passaggio 5: configurare gli strumenti dell'agente

Successivamente è sufficiente importare la libreria AgentFinish per configurare gli intermedi_steps integrando tutti i passaggi in sequenza per completare l'attività:

da langchain. schema . agente importare AgenteFinishpassaggi_intermedi = [ ]

Mentre VERO :

produzione = agente. invocare ( {

'ingresso' : 'lettere in buone condizioni' ,

'passi_intermedi' : passi_intermedi

} )

Se isinstance ( produzione , AgenteFinish ) :

risultato finale = produzione. valori_ritornati [ 'produzione' ]

rottura

altro :

stampa ( produzione. attrezzo , produzione. strumento_input )

attrezzo = {

'ottieni_lunghezza_parola' : ottieni_lunghezza_parola

} [ produzione. attrezzo ]

osservazione = attrezzo. correre ( produzione. strumento_input )

passaggi_intermedi. aggiungere ( ( produzione , osservazione ) )

stampa ( risultato finale )

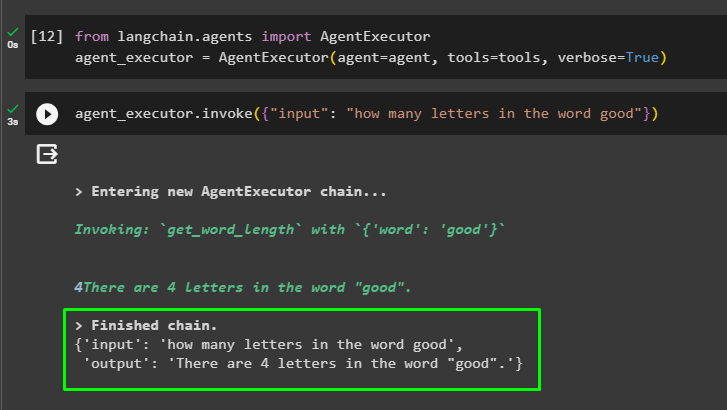

Passaggio 6: test dell'agente

Ora esegui l'agente chiamando il metodo AgentExecutor() dopo aver importato la sua libreria da LangChain:

da langchain. agenti importare AgentExecutoragente_esecutore = AgentExecutor ( agente = agente , utensili = utensili , prolisso = VERO )

Alla fine, richiama agent_executor con l'argomento di input per inserire la query per l'agente:

agente_esecutore. invocare ( { 'ingresso' : 'quante lettere nella parola buono' } )L'agente ha visualizzato la risposta alla domanda fornita nell'argomento di input dopo aver terminato la catena:

Tutto sta nel iniziare con gli agenti nel framework LangChain.

Conclusione

Per iniziare con gli agenti in LangChain, installa semplicemente i moduli richiesti per configurare l'ambiente utilizzando la chiave API OpenAI. Successivamente, configura il modello di chat impostando il modello di prompt per la creazione dell'agente con la sequenza di passaggi intermedi. Una volta configurato l'agente, è sufficiente creare gli strumenti specificando le attività dopo aver fornito la stringa di input all'utente. Questo blog ha dimostrato il processo di utilizzo degli agenti in LangChain.