Questa guida illustrerà il processo di caricamento delle catene da LangChain Hub.

Come aggiungere lo stato della memoria nella catena utilizzando LangChain?

Lo stato della memoria può essere utilizzato per inizializzare le catene in quanto può fare riferimento al valore recente memorizzato nelle catene che verrà utilizzato durante la restituzione dell'output. Per apprendere il processo di aggiunta di uno stato di memoria in catene utilizzando il framework LangChain, segui semplicemente questa semplice guida:

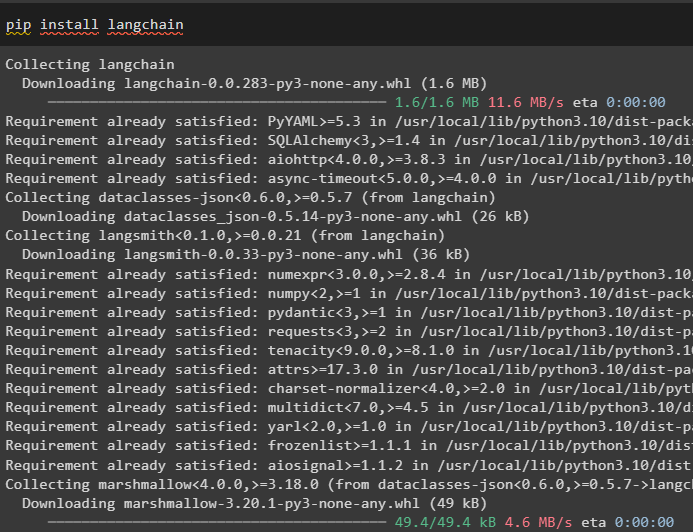

Passaggio 1: installare i moduli

Innanzitutto, entra nel processo installando il framework LangChain con le sue dipendenze utilizzando il comando pip:

pip installa langchain

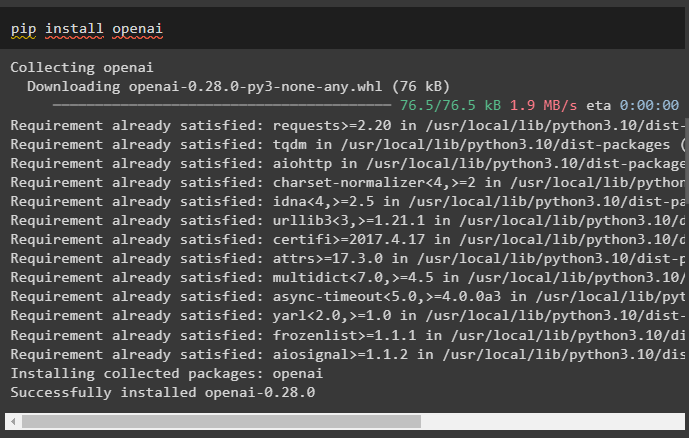

Installa anche il modulo OpenAI per ottenere le sue librerie che possono essere utilizzate per aggiungere lo stato della memoria nella catena:

pip installa openai

Ottieni la chiave API dall'account OpenAI e impostare l'ambiente utilizzandolo in modo che le catene possano accedervi:

importare Voi

importare getpass

Voi . circa [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Chiave API OpenAI:' )

Questo passaggio è importante affinché il codice funzioni correttamente.

Passaggio 2: importare librerie

Dopo aver configurato l'ambiente, importa semplicemente le librerie per aggiungere lo stato della memoria come LLMChain, ConversationBufferMemory e molte altre:

da langchain. Catene importare Catena di conversazionida langchain. memoria importare Memoria buffer di conversazione

da langchain. chat_models importare ChatOpenAI

da langchain. Catene . llm importare LLMChain

da langchain. richiede importare Modello Prompt

Passaggio 3: costruire catene

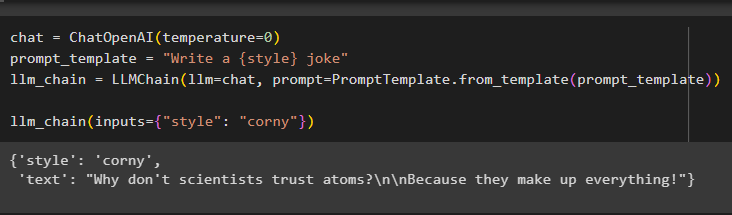

Ora crea semplicemente catene per LLM utilizzando il metodo OpenAI() e il modello del prompt utilizzando la query per chiamare la catena:

chiacchierata = ChatOpenAI ( temperatura = 0 )modello_prompt = 'Scrivi una battuta in {stile}'

llm_chain = LLMChain ( llm = chiacchierata , richiesta = Modello Prompt. da_modello ( modello_prompt ) )

llm_chain ( input = { 'stile' : 'banale' } )

Il modello ha visualizzato l'output utilizzando il modello LLM come mostrato nello screenshot seguente:

Passaggio 4: aggiunta dello stato della memoria

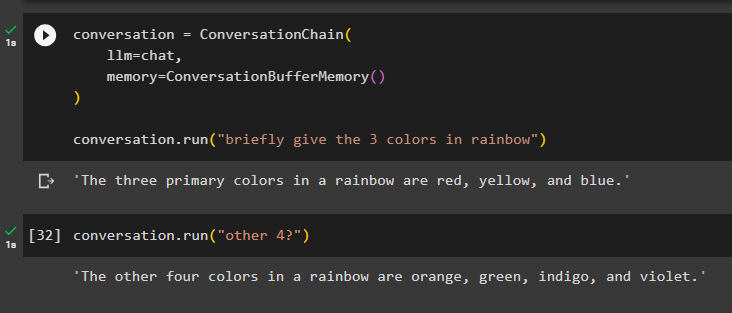

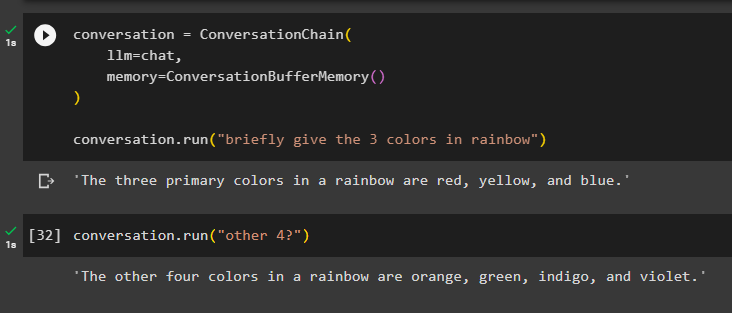

Qui aggiungeremo lo stato della memoria nella catena utilizzando il metodo ConversationBufferMemory() ed eseguiremo la catena per ottenere 3 colori dall'arcobaleno:

conversazione = Catena di conversazione (llm = chiacchierata ,

memoria = Memoria buffer di conversazione ( )

)

conversazione. correre ( 'indica brevemente i 3 colori dell'arcobaleno' )

Il modello ha visualizzato solo tre colori dell'arcobaleno e il contesto è archiviato nella memoria della catena:

Qui stiamo eseguendo la catena con un comando ambiguo come “ altri 4? ' quindi il modello stesso ottiene il contesto dalla memoria e visualizza i restanti colori dell'arcobaleno:

conversazione. correre ( 'altri 4?' )Il modello ha fatto esattamente questo, poiché ha compreso il contesto e ha restituito i restanti quattro colori del set arcobaleno:

Si tratta solo di caricare catene da LangChain Hub.

Conclusione

Per aggiungere la memoria in catene utilizzando il framework LangChain, è sufficiente installare i moduli per configurare l'ambiente per la creazione del LLM. Successivamente, importa le librerie necessarie per creare le catene in LLM e quindi aggiungivi lo stato della memoria. Dopo aver aggiunto lo stato della memoria alla catena, basta dare un comando alla catena per ottenere l'output e poi dare un altro comando nel contesto di quello precedente per ottenere la risposta corretta. Questo post ha elaborato il processo di aggiunta di uno stato di memoria in catene utilizzando il framework LangChain.